A Batida Policial e o Contexto Imediato da Investigação

Detalhes da Operação e o Foco no Chatbot Grok

Em 3 de fevereiro, uma equipe de procuradores franceses conduziu uma operação de busca e apreensão nos escritórios da X em Paris, um evento que capturou a atenção do setor tecnológico e regulatório global. A ação não foi uma medida isolada, mas sim parte de uma investigação mais ampla que visa analisar as práticas operacionais da plataforma, com especial atenção ao seu chatbot de inteligência artificial, Grok. Lançado como um concorrente direto de outras IAs conversacionais, Grok tem sido objeto de escrutínio devido às suas características e à forma como interage com os usuários, especialmente em relação à sua capacidade de gerar conteúdo e potencial para replicar ou amplificar vieses. As autoridades buscam compreender os mecanismos subjacentes aos algoritmos de Grok, investigando como eles são projetados, treinados e implantados, e se as suas saídas de conteúdo cumprem as normas éticas e legais francesas.

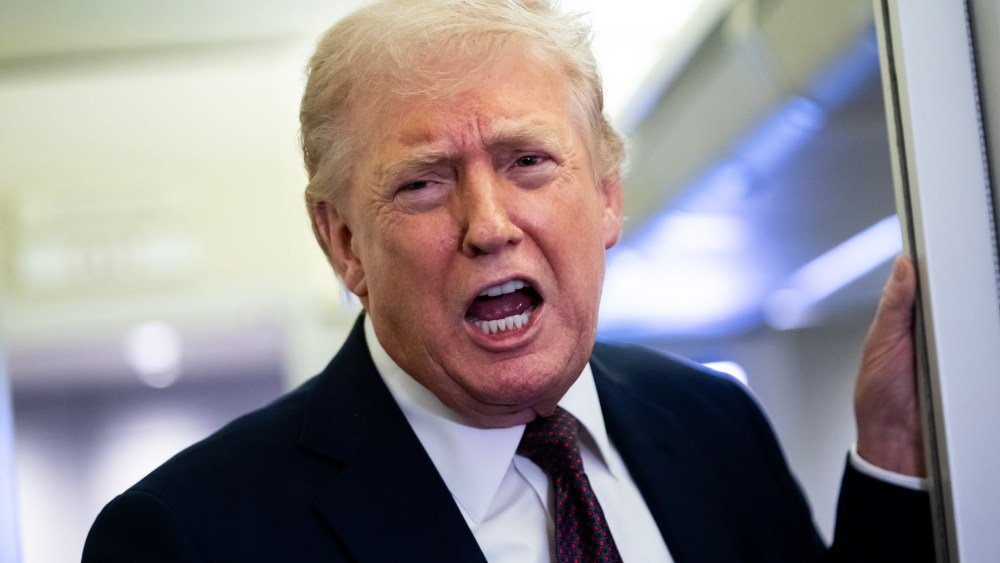

O inquérito foca particularmente na responsabilidade da X e de seus executivos, incluindo Elon Musk, pelas ações de seus algoritmos. A preocupação central gira em torno de como os vieses algorítmicos podem influenciar a percepção dos usuários, a desinformação e outros conteúdos potencialmente problemáticos gerados pelo chatbot. Este incidente sublinha uma clara mudança de paradigma, onde a responsabilidade não se limita mais apenas ao conteúdo criado por usuários, mas se estende ativamente às ferramentas de IA que a plataforma hospeda e desenvolve. A França, conhecida por sua postura rigorosa em relação à proteção de dados e direitos digitais, está na vanguarda de um movimento europeu que busca redefinir os limites da autonomia das grandes empresas de tecnologia, forçando-as a prestar contas pelas implicações sociais e políticas de suas inovações.

O Cenário Regulatório Europeu e a Pressão sobre a IA

A Lei de Serviços Digitais (DSA) e o Ato de IA como Pilar da Responsabilidade

A batida nos escritórios da X em Paris não pode ser vista isoladamente; ela se insere em um contexto regulatório europeu cada vez mais robusto e ambicioso. A União Europeia tem liderado o movimento global para regulamentar o setor digital, e duas de suas iniciativas mais notáveis são a Lei de Serviços Digitais (DSA) e o Ato de Inteligência Artificial (AI Act). A DSA, em vigor, impõe obrigações significativas às plataformas online para garantir um ambiente digital mais seguro e transparente. Entre suas disposições, exige que as plataformas controlem ativamente a disseminação de conteúdo ilegal, sejam transparentes sobre seus sistemas de recomendação e ofereçam mecanismos de contestação aos usuários. Para plataformas muito grandes, como a X, as obrigações são ainda mais rigorosas, incluindo a necessidade de avaliar e mitigar riscos sistêmicos, o que pode englobar os riscos associados a chatbots de IA como Grok.

Paralelamente, o Ato de IA, que está em processo de finalização e deverá ser uma das primeiras leis abrangentes de IA do mundo, classifica os sistemas de inteligência artificial com base em seu nível de risco. Sistemas de “alto risco”, que podem impactar direitos fundamentais ou a segurança dos cidadãos, enfrentarão requisitos estritos de conformidade, incluindo avaliações de conformidade, supervisão humana e transparência. Embora Grok possa não ser classificado diretamente como um sistema de “alto risco” em todas as suas aplicações, a preocupação com vieses e conteúdo problemático o coloca sob o guarda-chuva de uma fiscalização regulatória intensificada. A França, como membro influente da UE, tem sido uma voz forte na defesa de regulamentações que promovam a responsabilidade algorítmica e a proteção do consumidor. A investigação da X serve como um lembrete contundente de que a inovação tecnológica deve caminhar lado a lado com a responsabilidade social e a conformidade legal, e que a Europa não hesitará em usar seu poder regulatório para garantir isso. A postura de Elon Musk e suas declarações prévias sobre a “liberdade de expressão absoluta” na plataforma e o desenvolvimento da IA também podem ser contextualizadas neste cenário de crescente pressão regulatória, onde a autonomia corporativa é cada vez mais desafiada pelos imperativos da proteção pública e da ordem democrática.

Implicações Futuras para a X e o Futuro da Regulação da IA

A investigação francesa sobre a X e o chatbot Grok carrega consigo um peso significativo, com implicações que se estendem muito além das paredes dos escritórios parisienses. Para a X, o desdobramento deste inquérito pode resultar em sanções financeiras substanciais, como multas pesadas, caso se comprovem violações das leis vigentes. Além das penalidades monetárias, a empresa pode ser forçada a implementar mudanças operacionais significativas, revisando a arquitetura de seus algoritmos, intensificando a moderação de conteúdo gerado por IA e aumentando a transparência sobre o funcionamento de Grok. A reputação da X e da xAI, já sob escrutínio por diversas outras controvérsias, pode ser ainda mais afetada, impactando a confiança dos usuários e dos anunciantes em um mercado altamente competitivo.

No panorama mais amplo, esta ação da procuradoria francesa serve como um precedente importante para o futuro da regulação da inteligência artificial. Governos em todo o mundo estão lidando com o desafio de como regulamentar a IA de forma eficaz, promovendo a inovação ao mesmo tempo em que mitigam os riscos inerentes. A abordagem europeia, caracterizada por sua proatividade e rigor, indica uma direção clara: a era da autorregulação desenfreada das gigantes da tecnologia está chegando ao fim. O foco na responsabilidade de indivíduos e empresas por suas tecnologias de IA envia um sinal inequívoco de que os desenvolvedores e implementadores de sistemas de IA devem ser diligentes na consideração das implicações éticas e sociais de suas criações desde o estágio de design. A discussão sobre viés algorítmico, desinformação e manipulação por IA está no centro do debate, e casos como o da X em Paris solidificam a determinação dos reguladores em assegurar que a inteligência artificial sirva à sociedade de forma segura e justa, e não se torne uma ferramenta para amplificar problemas existentes ou criar novos desafios sociais. O futuro da IA e da sua governança está sendo moldado agora, e a França, juntamente com a União Europeia, está definindo um caminho para a responsabilização que certamente será observado e potencialmente emulado globalmente.

Fonte: https://screenrant.com